-

Medical journals

- Career

Umělé neuronové sítě a počítačové vidění v medicíně a chirurgii

Authors: M. Jiřík 1,3; V. Moulisová 1; M. Hlaváč 3; M. Železný 3,4; V. Liška 1,2

Authors‘ workplace: Biomedicínské centrum, Lékařská fakulta Univerzity Karlovy v Plzni 1; Chirurgická klinika, Fakultní nemocnice Plzeň a lékařská fakulta Univerzity Karlovy v Plzni 2; Výzkumné centrum NTIS, Fakulta aplikovaných věd, Západočeská univerzita v Plzni 3; Katedra kybernetiky, Fakulta aplikovaných věd, Západočeská univerzita v Plzni 4

Published in: Rozhl. Chir., 2022, roč. 101, č. 12, s. 564-570.

Category: Review

doi: https://doi.org/10.33699/PIS.2022.101.12.564–570Overview

Úvod: Umělé neuronové sítě se stávají důležitou technologií při analýze dat a jejich vliv začíná prostupovat i do oblasti medicíny. Naše pracoviště se dlouhodobě věnuje experimentální chirurgii, na to navazuje náš zájem o pokrok v ostatních oblastech moderních technologií a tím i umělých neuronových sítí. V rámci aktuálního čísla chceme prozkoumat i tento aspekt technického pokroku. Hlavním cílem je kritické zhodnocení silných i slabých stránek technologie umělých neuronových sítí s ohledem na využití v klinické a experimentální chirurgii.

Metody: V článku je věnována pozornost in-silico modelování a zejména pak možnostem neuronových sítí s ohledem na zpracování obrazových dat v medicíně. V textu je krátce shrnut historický vývoj hlubokého učení neuronových sítí a základní principy jejich fungování. Dále je představena taxonomie základních řešených úloh. Zmíněny jsou i možné problémy při učení i s možnostmi jejich řešení.

Výsledky: Článek poukazuje na rozličné možnosti umělých neuronových sítí v biologických aplikacích. Na řadě biomedicínských aplikací umělých neuronových sítí popisuje rozdělení a princip základních úloh strojového učení a hlubokého učení – klasifikace, detekce a segmentace.

Závěr: Aplikace metod umělých neuronových sítí mají v medicíně a chirurgii značný potenciál. Obcházejí potřebu zdlouhavého subjektivního nastavování parametrů znalostním inženýrem, neboť se učí přímo z dat. Při využití nevhodně vyváženého datasetu však může docházet k neočekávaným, avšak zpětně vysvětlitelným chybám. Řešení představuje vytvoření dostatečně bohatého datasetu pro učení a ověření funkce.

Klíčová slova:

hluboké učení – strojové učení – umělá neuronová síť – dataset

ÚVOD

Sepětí medicíny a technických oborů

Pokroky výsledků klinické medicíny jsou neodmyslitelně spjaty s technickým pokrokem. Vývoj na poli počítačové techniky a umělé inteligence je již několik dekád považován za významného přispěvatele tohoto pokroku. V posledním desetiletí však došlo v této oblasti k objevům týkajícím se umělých neuronových sítí (UNS), které lze, i v kontextu dlouhodobého úspěšného rozvoje, považovat za revoluční. Tyto objevy dozajista ovlivní většinu ostatních oborů lidské činnosti. Internetové sociální sítě, autonomní řízení automobilů a další oblasti blízké oboru původu objevu již jsou tímto vývojem zasaženy, zatímco vzdálenější oblasti lidské činnosti, jakými jsou například biologie a medicína, teprve významný dopad čeká.

Cílem tohoto textu je:

- Popsat, jak UNS fungují

- Vysvětlit, jak se UNS liší od tradičních metod

- Kriticky zhodnotit slabé a silné stránky UNS

- Představit významné aplikace UNS

V tomto textu se budeme věnovat zejména aplikacím neuronových sítí za účelem porozumění obrazu (počítačovému vidění). Vybíráme články, které byly publikovány v časopisech prvního a druhého kvartilu dle IF do roku 2022.

Typologie úloh strojového učení

Strojové učení je podoborem umělé inteligence, který se zabývá algoritmy, jejichž vnitřní parametry jsou určeny během procesu učení. To zvyšuje efektivitu algoritmu a jeho přizpůsobení se změnám prostředí. Úlohy řešené v rámci oboru se obvykle hierarchicky uspořádávají a na základní úrovni jsou rozděleny do dvou skupin: učení s učitelem (supervised learning) a učení bez učitele (unsupervised learning). Učení s učitelem využívá pro nastavení rozhodovacího algoritmu anotace dat, jež obsahují „správné“ výsledky, zatímco učení bez učitele taková data nemá a v zásadě se pokouší najít ve vstupních datech nápadné vzorce nebo shluky. Hluboké učení (deep learning) je disciplína strojového učení, která se zabývá zejména využíváním neuronových sítí a spadá do kategorie „učení s učitelem“. Úlohy v této kategorii se dále dělí na klasifikaci a regresi. Výstupem klasifikace jsou diskrétní kategorie (neboli třídy), zatímco výstupy regrese jsou spojité (čísla, vektory).

Metody tradičního počítačového vidění

Způsob práce tradičních metod počítačového vidění si lze přiblížit následujícím příkladem. Každý obrazový bod digitální fotografie je tvořen červeným, zeleným a modrým barevným kanálem, jejichž součtem vznikne výsledná barva pixelu. Chceme-li sledovat oranžový míč na záznamu z fotbalového utkání, nastaví znalostní inženýr na základě osobní zkušenosti rozhodovací algoritmus stroje tak, aby vybíral pixely, u nichž je hodnota v jednotlivých kanálech blízká barvě míče. Barevné kanály tvoří ve zmíněné úloze „příznakový vektor“ (feature vector). Pro řešení jiných úloh může být tento vektor tvořen například popisem tvaru objektu, případně jeho velikostí.

V našem případě bude zmíněný přístup fungovat, dokud některý z týmů neoblékne oranžové dresy. V takové situaci znalostní inženýr rozšíří příznakový vektor například o popis tvaru a textury míče. Toto představuje značnou odlišnost od hlubokého učení, kde je osobní vliv znalostního inženýra značně omezen.

Hluboké učení

Novodobý rozvoj hlubokého učení byl odstartován pokrokem v konvolučních neuronových sítích, které jsou zvláštním druhem UNS. Zásadní prvky této architektury nezávislé na prostorových posunech ve vstupních datech jsou známé již tři dekády [1] a byly rovněž použity na analýzu medicínských obrazů [2]. Reálnějšího uplatnění se dočkaly v oblasti rozpoznávání ručně psaných číslic [3], přesto však až do konce první dekády 21. století nebylo dosaženo významnějších úspěchů.

Průlom nastal v roce 2012, kdy v soutěži na klasifikaci obrázků zvítězila nad klasickými metodami s velkým náskokem konvoluční neuronová síť AlexNet [4], která novým způsobem využívala triku náhodného vypínání některých neuronů pro zvýšení robustnosti a rovněž profitovala z výpočetního výkonu moderních grafických karet. V následujícím bouřlivém vývoji se podařilo zlepšovat výkony hlubokého učení, ale i snižovat nároky na velikost trénovacích datasetů prostřednictvím přenášení zkušeností sítě z jiné úlohy (transfer learning), například při vyhodnocování osteoartrózy kolenního kloubu [5]. Širší přehled aplikací UMS v medicíně lze načerpat například v článku [6]. O obecnějších aplikacích hlubokého učení v bioinformatice se lze dočíst v souhrnném článku [7]. Základní ideou umělých neuronových sítí je, že větší množství jednoduše modelovaných neuronů bude jako propojený celek schopno komplexnějšího chování. Neurony umělých neuronových sítí bývají uspořádány do vrstev. Jednotlivý neuron jednoduše produkuje vážený součet vstupů od neuronů z předchozí vrstvy a výstup předává do další vrstvy přes nelineární aktivační funkci [8]. Právě tato nelinearita zajišťuje schopnost komplexního chování.

Učení neuronových sítí

Učení (někdy též trénování) neuronové sítě spočívá v nastavení vah. Síť AlexNet [9] je například určena 60 miliony parametrů vah a tvoří ji 650 tisíc neuronů. Váhy se nastavují prostřednictvím algoritmu „back-propagation“ [10]. Ten při nesprávné odpovědi sítě propaguje chybu od výstupních neuronů směrem k neuronům vstupním a upravuje váhy podle chyby tak, aby byla příště odpověď správnější. V průběhu učení se pak tento proces mnohokrát opakuje.

Typický způsob přípravy neuronových sítí se značně liší od metod tradičního počítačového vidění. V tradičních přístupech znalostní inženýr na základě svého úsudku volí příznaky a rozhodovací algoritmus, které budou vhodné pro řešení dané úlohy. Jak ukazuje Obr. 1, v neuronových sítích se tyto kroky vypouštějí a příznaky i rozhodovací algoritmus jsou zvoleny automaticky procesem učení [11] a znalostní inženýr zde pouze vybírá vhodná data pro učení. Tento mechanismus se nazývá „end to end training“. Hluboké učení díky tomu dokáže jediným přístupem řešit mnohem širší spektrum úloh než metody tradičního počítačového vidění.

Image 1. A) způsob práce s tradičními metodami počítačového vidění, které využívají návrh příznaků expertem; B) trénování metodami hlubokého učení, ve kterých jsou příznaky určeny automaticky. Převzato z [11]

Fig. 1. A) the traditional workflow of computer-vision methods using expert-based feature design; B) training by deep learning methods where the symptoms are determined automatically. Source: [11]![A) způsob práce s tradičními metodami počítačového vidění, které využívají návrh příznaků expertem;

B) trénování metodami hlubokého učení, ve kterých jsou příznaky určeny automaticky. Převzato z [11] <br>

Fig. 1. A) the traditional workflow of computer-vision methods using expert-based feature design; B) training

by deep learning methods where the symptoms are determined automatically. Source: [11]](https://www.prolekare.cz/media/cache/resolve/media_object_image_small/media/image_pdf/cdce5bbfdeb4a8da73c6532f6fe8ee4d.png)

Klasifikace

Proces trénování si více teoreticky přiblížíme na úloze klasifikace kožního karcinomu, který je v posledních letech z pohledu počítačového vidění hojně studován [12,13,14]. Podobně jako autoři článku [15] k tomu můžeme použít 25 tisíc dermoskopických snímků, které jsou lidskými anotátory rozděleny do osmi tříd: melanom, melanocytový névus, bazaliom, aktinická keratóza, benigní keratóza, dermatofibrom, vaskulární léze a spinocelulární karcinom. V průběhu trénování vždy ukážeme neuronové síti obrázek a jako odpověď od UNS obdržíme predikci třídy a míru sebedůvěry v predikci (věrohodnost). Na počátku trénování bude tato predikce náhodná. Využijeme však znalosti správné odpovědi a mírně upravíme parametry (váhy) v síti tak, aby byla napříště predikce sítě provedena s menší chybou. Úpravu vah opakujeme pro každý obrázek několikrát a postupně se bude chybovost sítě snižovat.

Praktickou možností, jak hluboké učení okusit, je webová aplikace Teachable Machine [16] (https://teachablemachine. withgoogle.com/). Bez nutnosti cokoliv instalovat je možné za pár minut natrénovat klasifikaci čehokoliv, co máte po ruce, stačí webkamera.

Detekce, lokalizace a sledování objektu

Cílem úlohy detekce objektu je zjistit, zda se daný objekt v obraze nachází, a určit jeho umístění v obraze. Přirozeným obrazovým materiálem v oblasti počítačového vidění je 2D fotografie. Většina vyvíjených metod je proto vhodná právě pro tento typ vstupních dat. Ve 3D byla například řešena detekce mikrokrvácení z MR mozku [17].

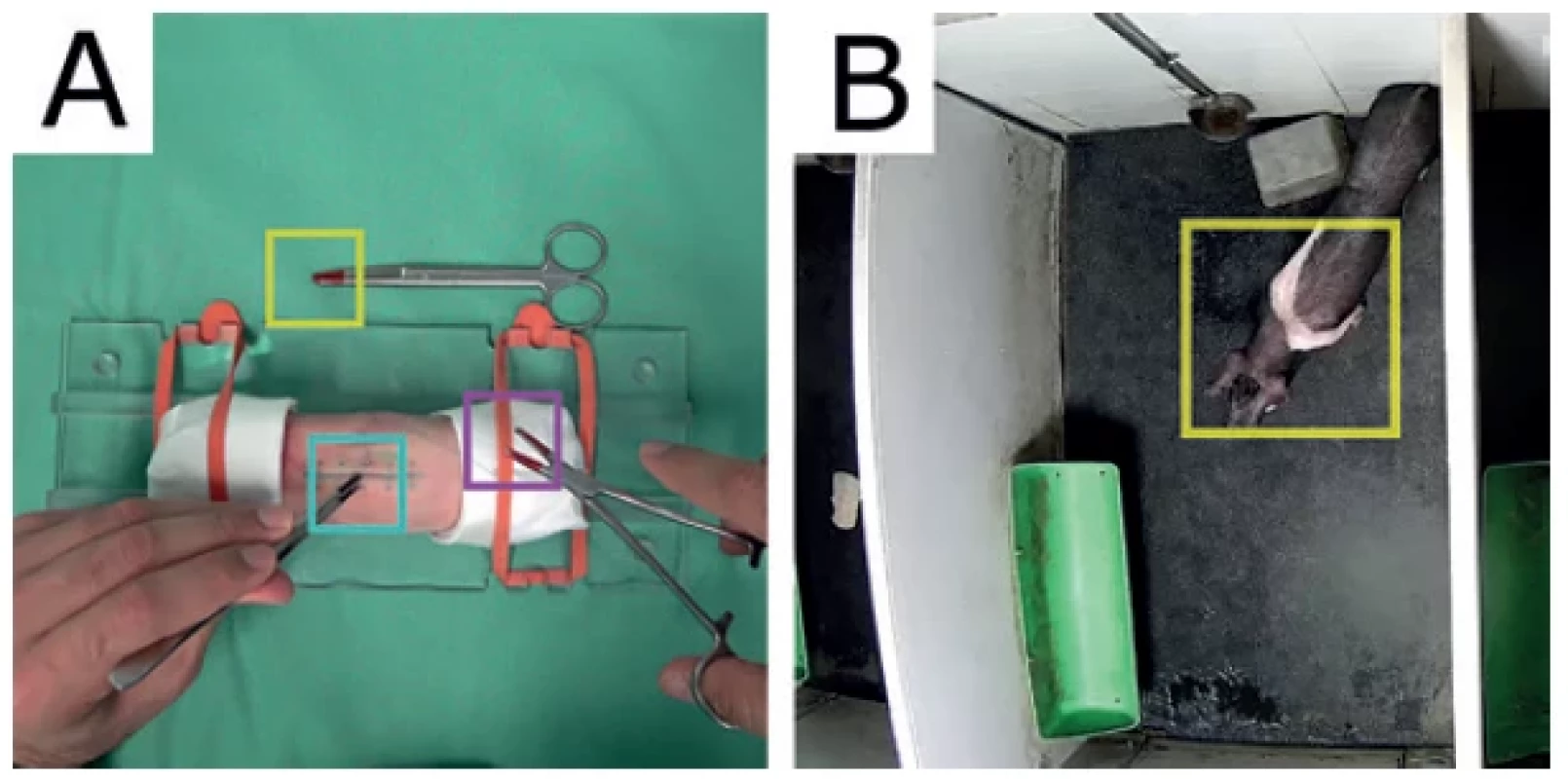

Příbuznou úlohou k detekci je sledování. Cílem může být sledování rekonvalescence experimentálního zvířete prostřednictvím analýzy ohybu a jeho ušlé vzdálenosti při pohledu shora, které řešíme na našem pracovišti (viz Obr. 2B). Další úlohou je (Obr. 2A) sledování koncového bodu jehelce a dalších chirurgických nástrojů s cílem objektivního hodnocení studentů na kurzech chirurgického šití pomocí analýzy pohybu [18]. Jiné týmy se věnují analýze vzdálenosti [19] nebo komplexnější analýze gest [20] při šití s pomocí robota.

Image 2. A) sledování špiček chirurgických nástrojů pro analýzu pohybu − jehelec (fialová), pinzeta (azurová) a nůžky (žlutá); B) sledování rekonvalescence experimentálního zvířete na základě pohybu; žlutý rámeček označuje automaticky detekované zvíře.

Fig. 2. A) monitoring the tips of surgical instruments for motion analysis – the needle (purple), tweezers (cyan) and scissors (yellow); B) monitoring the recovery of an experimental animal based on movement; the yellow box indicates the automatically detected animal.

Segmentace

V úloze segmentace je cílem najít hranici objektu ve vstupním obraze, jedná se vlastně o zvláštní druh klasifikace pro každý pixel. Často využívanou architekturou pro řešení této úlohy je U-Net [21], který byl poprvé použit v biomedicínském kontextu pro segmentace nervové soustavy octomilky v mikroskopických obrazech.

Provádění volumetrických segmentací (z množství CT řezů) je náročné na paměť grafické karty, přesto je však proveditelné. Na našem pracovišti se věnujeme segmentacím intralobulární a extralobulární tkáně v histologických obrazech jater [22], které jsou následně využity ke kvantitativní analýze specifických oblastí preparátů [23] nebo segmentaci jater ze snímků z výpočetní tomografie, kde pro vylepšování výsledků využíváme dodatečné informace o relativní poloze voxelů vůči robustně detekovatelným tkáňovým strukturám (páteř, plíce) [24]. Výsledek takové segmentace ukazuje Obr. 3. Jiná pracoviště se věnují například deformovatelnému modelování jater [25].

Image 3. Segmentace jater pomocí konvoluční neuronové sítě s rozšířenou informací o poloze v axiálních řezech z výpočetní tomografie. Převzato z článku [24].

Fig. 3. Liver segmentation using a convolutional neural network with extended information on the position in axial sections from computed tomography. Source: [24].![Segmentace jater pomocí konvoluční neuronové sítě s rozšířenou informací o poloze v axiálních řezech z výpočetní

tomografie. Převzato z článku [24]. <br>

Fig. 3. Liver segmentation using a convolutional neural network with extended information on the position in axial

sections from computed tomography. Source: [24].](https://www.prolekare.cz/media/cache/resolve/media_object_image_small/media/image_pdf/38fb35cecc374a0c2b289c0aeafdd1e2.png)

Kdy to nefunguje…

Ač není předchozí text vyčerpávajícím výčtem veškerých aplikací UMS v medicíně, na základě necelé dvacítky článků jsou v něm demonstrovány silné stránky „end to end“ přístupu k trénování. Ten má však také slabiny. Kromě volby trénovací množiny obrázků nemáme mnoho možností, jak ovlivnit výsledek. Obr. 4 ukazuje v horní řádce trénovací data pro třídu A a B. Po natrénování předkládáme síti neznámé obrázky z modrého a červeného rámečku. V případě modře orámovaných se nejspíše člověk se strojem shodne. Obrázky z červeného však lidé obvykle určují jinak než stroj. Stroj se totiž, ve shodě s trénovací množinou, rozhoduje na základě polohy objektu a ignoruje jeho tvar.

Image 4. Rozdíly mezi člověkem a strojem v chápání trénovacích dat Horní řádek obsahuje trénovací sadu pro třídy A a B. Po natrénování má síť za úkol klasifikovat neviděná data v modrém a červeném rámečku. Zatímco data z modrého rámečku jsou klasifikována očekávaným způsobem, u červených dat může být rozhodnutí překvapivé. Síť se totiž nečekaně rozhoduje podle polohy objektů. Převzato a upraveno z článku [26].

Fig. 4. Differences between man and machine in understanding training data The top row contains the training set for classes A and B. After training, the network has the task of classifying unseen data in the blue and red boxes. While the data in the blue box is classified as expected, the decision may be surprising for red data as the network unexpectedly decides according to the location of objects. Adapted from [26].![Rozdíly mezi člověkem a strojem v chápání trénovacích dat

Horní řádek obsahuje trénovací sadu pro třídy A a B. Po natrénování má síť za úkol klasifikovat neviděná data v modrém

a červeném rámečku. Zatímco data z modrého rámečku jsou klasifikována očekávaným způsobem, u červených dat může

být rozhodnutí překvapivé. Síť se totiž nečekaně rozhoduje podle polohy objektů. Převzato a upraveno z článku [26]. <br>

Fig. 4. Differences between man and machine in understanding training data

The top row contains the training set for classes A and B. After training, the network has the task of classifying unseen data

in the blue and red boxes. While the data in the blue box is classified as expected, the decision may be surprising for red

data as the network unexpectedly decides according to the location of objects. Adapted from [26].](https://www.prolekare.cz/media/cache/resolve/media_object_image_small/media/image_pdf/83698b9767df7de71fd33b241c28e0a7.png)

Praktickým příkladem je práce [27], ve které bylo cílem klasifikace rozpoznat bronchopneumonii na plicním skiagramu z různých nemocnic. Rozhodování však selhávalo. Ukázalo, že algoritmus při rozhodování vůbec nesledoval hrudník pacienta. Prevalence nemoci se v jednotlivých nemocničních zařízeních, která dodávala snímky, lišila. Obr. 5 červenou barvou zvýrazňuje, nač se síť zaměřovala při rozhodování, a je vidět, že se síť naučila podle značky v rohu snímku poznat nemocnici, ze které pacient přicházel, a podle toho do určité míry odhadla, zda má zápal plic. Přidáním značek i do několika obrázků z jiných nemocnic lze síť tomuto chování odnaučit.

Image 5. Pomocí „teplotní mapy“ můžeme zobrazit, které části obrázku jsou použity pro rozhodování (A). Na obrázku B a C je vidět, že se síť zaměřuje na horní roh obrázku, do kterého technici v jedné nemocnici umisťují značku. Převzato z [27].

Fig. 5. The „heat map“ shows which parts of the image are used for decision making (A). As illustrated by Figures B and C, the network focuses on the upper corner of the image where technicians in one hospital place a metal token. Source: [27].![Pomocí „teplotní mapy“ můžeme zobrazit, které části obrázku jsou použity pro rozhodování (A). Na obrázku

B a C je vidět, že se síť zaměřuje na horní roh obrázku, do kterého technici v jedné nemocnici umisťují značku.

Převzato z [27]. <br>

Fig. 5. The „heat map“ shows which parts of the image are used for decision making (A). As illustrated by Figures B

and C, the network focuses on the upper corner of the image where technicians in one hospital place a metal token.

Source: [27].](https://www.prolekare.cz/media/cache/resolve/media_object_image_small/media/image_pdf/32675f7f54e2781111b50fc60fb00535.png)

ZÁVĚR

Ukazuje se, že moderní techniky hlubokého učení přinášejí nové možnosti i do medicínských oborů. Mezi základní řešené úlohy v oblasti vidění patří klasifikace, detekce a segmentace, ale obdobné problémy lze řešit například pro textová data. Klíčovým úkolem při nastavování neuronových sítí je příprava dat. Je jich zapotřebí značné množství, musejí být řádně anotovaná a musejí reprezentativně zastupovat případy, se kterými se síť v budoucnu setká.

V blízké budoucnosti lze očekávat využití UNS v chirurgii zejména v předoperační a pooperační době, jak se ukazuje například při predikci mortality a predikci prodloužení hospitalizace při terapii syndromu hypoplastického levého srdce [28] nebo predikci recidivy obrovskobuněčného kostního nádoru po kyretáži [29]. Experimentální chirurgie pak bude stále častěji využívat flexibility UNS pro vyhodnocení experimentů inovativním způsobem. Příkladem budiž hodnocení kvality jaterního scaffoldu [23]. Hojnější využívání UNS v průběhu výkonu, například navigací prostřednictvím rozšířené reality [30], pak možná přinese vzdálenější budoucnost.

Poděkování

Tato práce vznikla za podpory projektu UNCE/MED/006 – Centrum klinické a experimentální jaterní chirurgie financovaného z Univerzity Karlovy. Tento výstup dále vznikl v rámci programu Cooperatio, vědní oblasti SURG.

Konflikt zájmů

Autoři článku prohlašují, že nejsou v souvislosti se vznikem tohoto článku ve střetu zájmů a že tento článek nebyl publikován v žádném jiném časopise, s výjimkou kongresových abstrakt a doporučených postupů.

Ing. Miroslav Jiřík, Ph.D.

LF UK v Plzni a Biomedicínské centrum v Plzni

alej Svobody 1655/76

323 00 Plzeň – Severní Předměstí

e-mail: miroslav.jirik@gmail.comRozhl Chir. 2022;101 : 564–570

Sources

1. Fukushima K. Neocognitron: A self-organizing neural network model for a mechanism of pattern recognition unaffected by shift in position. Biological Cybernetics 1980;36(4):193–202. doi:10.1007/ BF00344251.

2. Lo SCB, Lou SLA, Lin JS, et al. Artificial convolution neural network techniques and applications for lung nodule detection. IEEE Transactions on Medical Imaging 1995;14(4):711–718.

3. LeCun Y, Bottou L, Bengio Y, et al. Gradient-based learning applied to document recognition. Proceedings of the IEEE 1998;86(11):2278–2323. doi:10.1109/5.726791.

4. Krizhevsky A, Sutskever I, Hinton GE. Imagenet classification with deep convolutional neural networks. Advances in Neural Information Processing Systems 2012;25.

5. Antony J, McGuinness K, O’Connor NE, et al. Quantifying radiographic knee osteoarthritis severity using deep convolutional neural networks. Proceedings – International Conference on Pattern Recognition 2016;0 : 1195–1200. doi:10.1109/ ICPR.2016.7899799.

6. Litjens G, Kooi T, Bejnordi BE, et al. A survey on deep learning in medical image analysis. Medical Image Analysis 2017;42(1995):60–88. doi:10.1016/j.media. 2017.07.005.

7. Ravi D, Wong C, Deligianni F, et al. Deep learning for health informatics. IEEE Journal of Biomedical and Health Informatics 2017;21(1):4–21. doi:10.1109/ JBHI.2016.2636665.

8. Rosenblatt F. The perceptron – a perceiving and recognizing automaton. Report 85, Cornell Aeronautical Laboratory 1957 : 460–461.

9. Krizhevsky A, Sutskever I, Hinton GE. Imagenet classification with deep convolutional neural networks. Communication of the ACM 2017;60(6). doi:10.1145/3065386.

10. Rumelhart DE, Hinton GE, Williams RJ. Learning representations by back-propagating errors. Nature 1986;323(6088): 533–536. doi:10.1038/323533a0.

11. O’Mahony N, Campbell S, Carvalho A, et al. Deep learning vs. traditional computer vision. In: Arai K, Kapoor S, editors. Advances in computer vision. Cham, Springer International Publishing 2020 : 943. doi:10.1007/978-3-030-17795-9_10.

12. Haggenmüller S, Maron RC, Hekler A, et al. Skin cancer classification via convolutional neural networks: systematic review of studies involving human experts. European Journal of Cancer 2021;156 : 202–216. doi:10.1016/j. ejca.2021.06.049.

13. Naeem A, Farooq MS, Khelifi A, et al. Malignant melanoma classification using deep learning: Datasets, performance measurements, challenges and opportunities. IEEE Acces 2020;8 : 110575–110594. doi:10.1109/ACCESS.2020.3001507.

14. Wen D, Khan SM, Xu AJ, et al. Characteristics of publicly available skin cancer image datasets: a systematic review. The Lancet Digital Health 2022;4(1):e64–e74. doi:10.1016/S2589-7500(21)00252-1.

15. Kassem MA, Hosny KM, Fouad MM. Skin lesions classification into eight classes for ISIC 2019 using deep convolutional neural network and transfer learning. IEEE Acces 2020;8 : 114822–114832. doi:10.1109/ ACCESS.2020.3003890.

16. Carney M, Webster B, Alvarado I, et al. Teachable machine: Approachable webbased tool for exploring machine learning classification. Conference on Human Factors in Computing Systems – Proceedings 2020. doi: 10.1145/3334480.3382839.

17. Dou Q, Chen H, Yu L, et al. Automatic detection of cerebral microbleeds from MR images via 3D convolutional neural networks. IEEE Transactions on Medical Imaging 2016; 35(5):1182–1195. doi:10.1109/TMI.2016.2528129.

18. Krejčí J, Straka O, Vyskočil J, et al. Feature - based multi-object tracking with maximally one object per class. FUSION 2022.

19. Wang Z, Majewicz Fey A. Deep learning with convolutional neural network for objective skill evaluation in robot-assisted surgery. International Journal of Computer Assisted Radiology and Surgery 2018; 13(12):1959–1970. doi:10.1007/ s11548-018-1860-1.

20. Luongo F, Hakim R, Nguyen JH, et al. Deep learning-based computer vision to recognize and classify suturing gestures in robot-assisted surgery. Surgery (United States) 2021;169(5):1240–1244. doi:10.1016/j.surg.2020.08.016.

21. Ronneberger O, Fischer P, Brox T. U-Net: Convolutional networks for biomedical image segmentation. Medical image computing and computer-assisted intervention (MICCAI), vol. 9351, Springer 2015.

22. Jirik M, Gruber I, Moulisova V, et al. Semantic segmentation of intralobular and extralobular tissue from liver scaffold H&E images. Sensors (Switzerland) 2020;20(24):1–12. doi:10.3390/ s20247063.

23. Moulisová V, Jiřík M, Schindler C, et al. Novel morphological multi-scale evaluation system for quality assessment of decellularized liver scaffolds. Journal of Tissue Engineering 2020;11 : 2041731420921121. doi:10. 1177/2041731420921121.

24. Jiřík M, Hácha F, Gruber I, et al. Why use position features in liver segmentation performed by convolutional neural network. Frontiers in Physiology 2021;12(October):1–9. doi:10.3389/ fphys.2021.734217.

25. Brunet JN, Mendizabal A, Petit A, et al. Physics-based deep neural network for augmented reality during liver surgery. Lecture notes in computer science (including subseries lecture notes in artificial intelligence and lecture notes in bioinformatics) 2019; 11768 LNCS:137–145. doi:10.1007/978-3-030-32254-0_16.

26. Geirhos R, Jacobsen JH, Michaelis C, et al. Shortcut learning in deep neural networks Nature Machine Inteligence 2020;666–673.

27. Zech JR, Badgeley MA, Liu M, et al. Variable generalization performance of a deep learning model to detect pneumonia in chest radiographs: A cross-sectional study. PLoS Medicine 2018;15(11):1–17. doi:10.1371/journal.pmed.1002683.

28. Jalali A, Lonsdale H, Do N, et al. Deep learning for improved risk prediction in surgical outcomes. Scientific Reports 2020;10(1),9289. doi:10.1038/s41598 - 020-62971-3.

29. He Y, Guo J, Ding X, et al. Convolutional neural network to predict the local recurrence of giant cell tumor of bone after curettage based on pre-surgery magnetic resonance images. European Radiology 2019; 29(10):5441–5451. doi:10.1007/ s00330-019-06082-2.

30. Ghaednia H, Fourman MS, Lans A, et al. Augmented and virtual reality in spine surgery, current applications and future potentials. The Spine Journal 2021;21(10):1617–1625. doi:10.1016/J. SPINEE.2021.03.018.

Labels

Surgery Orthopaedics Trauma surgery

Article was published inPerspectives in Surgery

2022 Issue 12-

All articles in this issue

- Experimentální chirurgie

- Umělé neuronové sítě a počítačové vidění v medicíně a chirurgii

- Tepny hlavy a krku prasete domácího z pohledu zobrazovacích metod a experimentální chirurgie

- Permanentní žilní přístup v experimentální chirurgii – naše zkušenosti

- Chirurgie v době koronavirové

- Zavedení in vivo modelů karcinomu pankreatu pro studium nových terapeutických režimů

- Konfokální laserová endomikroskopie v pooperačním hodnocení perfuze kolorektální anastomózy – experimentální studie

- Experimentální chirurgie jako součást vývoje degradabilních biomateriálů v kardiovaskulární chirurgii

- Léčba chylothoraxu embolizací hrudního mízovodu

- Perspectives in Surgery

- Journal archive

- Current issue

- Online only

- About the journal

Most read in this issue- Tepny hlavy a krku prasete domácího z pohledu zobrazovacích metod a experimentální chirurgie

- Léčba chylothoraxu embolizací hrudního mízovodu

- Zavedení in vivo modelů karcinomu pankreatu pro studium nových terapeutických režimů

- Permanentní žilní přístup v experimentální chirurgii – naše zkušenosti

Login#ADS_BOTTOM_SCRIPTS#Forgotten passwordEnter the email address that you registered with. We will send you instructions on how to set a new password.

- Career